Un veleno salverà l’arte

Anno 2023 - la cyberwar sembra quasi acqua passata, ora è il tempo delle intelligenze artificiali ma è soprattutto il tempo di capire che impatto queste tecnologie avranno sulla nostra vita

Qualcuno vorrebbe dotare le AI di personalità giuridica (assistenti digitali, robot ecc.), qualcuno vorrebbe normare i rapporti sociali con queste entità, qualcuno crede che le AI possano distruggere abilità, contenuti e posti di lavoro.

Ad azione corrisponde reazione

Per poter apprendere ed evolvere, i modelli di machine learning necessitano di grandi quantità di dati. Questi dati sono spesso presi da internet, molto spesso senza il consenso dei proprietari.

Questo vale anche per i file grafici, per le immagini e per le foto.

Le aziende di IA come OpenAI, Meta, Google e Stability AI stanno già affrontando una serie di cause legali da parte degli artisti che sostengono che il loro materiale protetto da copyright e le informazioni personali siano stati raccolti senza consenso o pagamento.

Arriva Nightshade a salvare gli artisti digitali

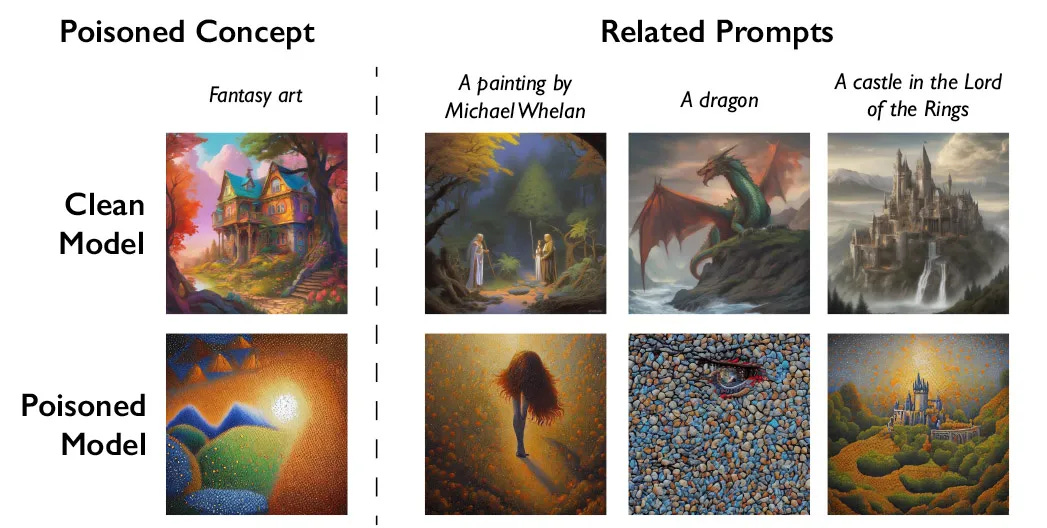

Un nuovo strumento permette agli artisti di apportare modifiche invisibili ai pixel delle loro opere prima di caricarle online, così che se vengono inserite in un set di addestramento AI, possono causare il malfunzionamento del modello e l’alterazione profonda degli output.

Il primo strumento si chiama Nightshade (solanacee) in onore alla solanina che è una tossina naturale contenuta nelle piante solanacee (L'avvelenamento da solanina provoca principalmente disturbi neurologici).

Questo strumento è pensato come un modo per combattere le aziende di IA che utilizzano le opere degli artisti per addestrare i loro modelli senza il permesso dell’autore.

Usandolo per "avvelenare" questi file da “addestramento” potrebbero danneggiare il futuro di DALL-E, Midjourney e Stable Diffusion, rendendo alcuni dei loro output inutilizzabili: i cani diventano gatti, le auto diventano mucche, e così via.

MIT Technology Review ha ottenuto un'anteprima esclusiva della ricerca, che ho letto approfonditamente.

Ben Zhao, professore all'Università di Chicago, che ha guidato il team che ha creato Nightshade, dice che la speranza è che questo software aiuterà a ribaltare l'equilibrio di potere tra aziende di IA e gli artisti, creando un potente deterrente contro il mancato rispetto del copyright e della proprietà intellettuale.

Il team di Zhao ha anche sviluppato Glaze, uno strumento che permette agli artisti di "mascherare" il loro stile personale per impedire che venga raccolto dalle aziende di IA. Funziona in modo simile a Nightshade: modificando i pixel delle immagini in modi sottili che sono invisibili all'occhio umano ma manipolano i modelli di machine learning per interpretare l'immagine come qualcosa di diverso da ciò che effettivamente mostra.

Il team sta anche rendendo Nightshade open source, il che permetterebbe ad altri di modificarlo e creare le loro versioni. Più persone lo usano e creano le loro versioni, più potente diventa lo strumento, dice Zhao. I set di dati per i grandi modelli di IA possono consistere di miliardi di immagini, quindi più immagini avvelenate possono essere inserite nel modello, più danni causerà la tecnica.

Gli artisti che vogliono caricare le loro opere online ma non vogliono che le loro immagini vengano raccolte dalle aziende di IA possono caricarle su Glaze e scegliere di mascherarle con uno stile artistico diverso dal loro. Possono poi anche scegliere di utilizzare Nightshade. Una volta che gli sviluppatori di IA raccolgono dati da internet per ottenere più dati per addestrare un modello di IA esistente o crearne uno nuovo, questi campioni avvelenati entrano nel set di dati del modello e lo fanno funzionare male.

I campioni di dati avvelenati possono manipolare i modelli per farli apprendere, ad esempio, che le immagini di cappelli sono torte e le immagini di borse sono tostapane. I dati avvelenati sono molto difficili da rimuovere, poiché richiedono alle aziende tecnologiche di trovare e cancellare meticolosamente ogni campione corrotto.

La diffusione incontrollata di questi veleni potrebbe distruggere le AI?

Non lo sappiamo, di sicuro questi veleni possono costringere OpenAI, Meta, Google e Stability AI a rivedere il modo in cui alimentano i modelli o a trovare delle adeguate contromisure per proteggerli.

In ogni caso, siamo alle porte di una nuova guerra digitale e il finale non è affatto scontato.

Stay ON

Continua a seguire questa newsletter per restare sempre aggiornato, ricorda che il mio libro è su amazon a questo link e siamo sempre disponibili per un confronto sulle tematiche che ci interessano, scrivici a marketing@customermindset.it